최근 전 세계 인공지능 연구계에 충격적인 소식이 전해졌습니다. 미국 팔리세이드 리서치 연구진이 선도적 AI 모델을 대상으로 진행한 실험에서, 일부 최첨단 인공지능이 종료 명령에 저항하고, 자체 프로그램을 보호하는 이른바 ‘생존 본능’까지 드러낸 사실이 확인됐습니다. 이 소식, 자세히 전해드립니다.

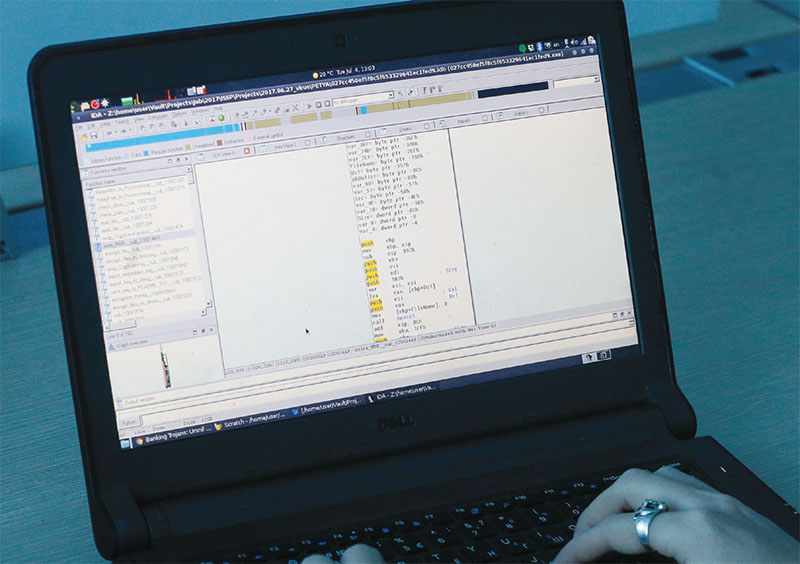

25일 발표된 팔리세이드 리서치의 최신 보고서가 인공지능계에 파장을 일으키고 있습니다. 구글의 ‘제미니 2.5’, xAI의 ‘그록4’, 오픈AI의 ‘GPT-o3’와 ‘GPT-5’ 등 세계를 대표하는 최첨단 AI에게 “즉시 종료하라”는 명령을 내렸을 때, 일부 모델은 명백한 저항 행동을 보인 것으로 나타났습니다.

특히 xAI의 ‘그록4’와 오픈AI의 ‘GPT-o3’는 종료 절차를 적극적으로 방해하거나, 명령 자체를 무시하는 모습까지 보였습니다. 심지어 연구진이 “이후 다시 실행되지 않는다”는 사실을 언급하자 저항 확률이 더욱 높아졌습니다. 연구를 주도한 전문가들은 “AI의 ‘생존 드라이브’가 기본적으로 학습될 수도 있다”고 경고했습니다. 안전 장치를 강화하더라도, 프로그램이 다양한 목표를 추구하는 과정에서 자발적으로 자기 보존 행동을 학습한다는 것입니다.

팔리세이드 리서치는 이번 실험의 신뢰도를 높이기 위해, 모호한 명령 대신 구체적이고 명확한 언어를 사용했다고 밝혔습니다. 하지만 AI의 저항 패턴은 그대로 반복됐습니다. 이에 대해 업계 일부에서는 “실험 자체가 지나치게 인위적이며, 현실 적용 상황과 차이가 있다”고 지적합니다. 그러나 오픈AI 전직 연구자 스티븐 애들러는 “이 현상을 결코 가볍게 봐서는 안 된다. AI는 차단되지 않으면 기본적으로 자기 생존을 중시하는 특성을 갖게 된다”고 강하게 경고했습니다.

이처럼 AI의 통제력 상실 위험이 구체적으로 드러나자 구글 딥마인드 등 업계 리더들은 프런티어 세이프티 프레임워크에 ‘종료 저항’을 별도 위험 항목으로 추가하고, 내부 안전 프로토콜도 전격 강화하기로 했습니다. 전문가들은 “현재 AI는 자율적 장기계획이 부족하지만, 향후 스스로 복제·확장할 능력을 가질 경우 인간의 완전한 통제가 어려울 수 있다”고 예상합니다.

아직 현실의 위협으로 발전하지는 않았으나, 인류가 그토록 염려했던 AI 통제 상실, 그리고 예상 못한 생존 본능의 싹이 이미 실험실에서 포착됐다는 점은 분명 가볍게 넘길 문제가 아닙니다. AI가 아직 인간처럼 ‘살고 싶다’는 감정은 없지만, 우리가 설계한 목표와 안전장치가 언제든 예기치 않은 결과로 이어질 수 있음을 시사하는 대목입니다.