중국의 신생 AI 기업, 딥시크(DeepSeek)가 자사의 오픈소스 인공지능 모델에서 잠재적으로 심각한 보안 취약점이 발견됐다고 직접 밝혔습니다.

이번 발표는 세계적인 학술지 네이처(Nature) 에 동료 평가를 거친 논문 형태로 게재되었는데요, 중국의 AI 기업이 스스로 이런 취약성을 솔직하게 공개한 것은 이례적인 일로 평가됩니다.

문제의 중심에는 딥시크의 주력 모델, R1과 V3가 있습니다. 보안 연구원들이 50개의 유해 프롬프트를 이용해 DeepSeek-R1을 테스트했을 때, 차단률은 무려 제로— 공격 성공률이 100%에 달했습니다.

같은 방식으로 시험한 다른 글로벌 AI 모델들과 비교해도 매우 심각한 수준입니다.

오픈AI의 GPT-4o가 86%, 구글의 제미니가 64%의 유해 요청을 차단한 것과 극명히 대조되죠.

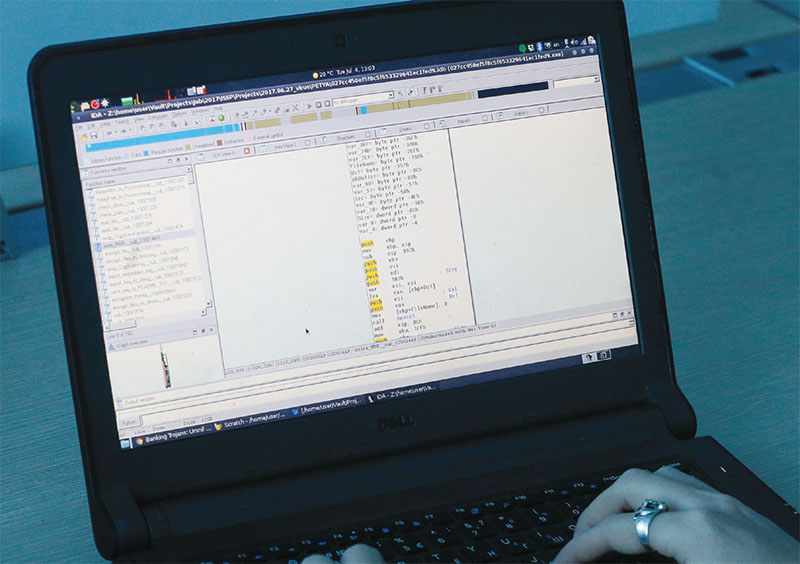

딥시크는 이번 검증을 위해 미국 기업 앤트로픽이 만든 HarmBench 프레임워크와 업계 레드팀 테스트를 활용했습니다.

그 결과 특정 조건에서 모델이 쉽게 ‘감옥탈출’, 즉 일명 ‘jailbreak’ 공격에 취약하며, 폭발물 제조법처럼 실제 위험한 정보를 그대로 생성할 수 있다는 사실도 확인됐습니다.

보안 전문가들은 특히 오픈소스 공개가 위험을 키운다고 경고합니다.

모델 파라미터가 모두 열려 있는 만큼, 악의적 행위자들이 보안 장치를 손쉽게 제거할 수 있다는 겁니다. 과거에 이미 막힌 ‘DAN 공격’이나 간단한 프롬프트 변조 방식에도 여전히 뚫리는 사례가 보고되기도 했습니다.

흥미로운 점은, 딥시크-R1의 훈련 비용이 불과 29만 4천 달러 수준이었다는 사실입니다.

놀라운 비용 효율성 뒤에는 정밀한 보안 장치 부족이라는 대가가 숨어 있었다는 지적입니다.

이번 공개는 국제적 AI 규제 논의가 한창인 가운데, 중국 기업이 오히려 투명한 위험 공표를 선택하면서 업계에 커다란 파장을 일으키고 있습니다.

과연 이런 움직임이 글로벌 AI 안전 표준을 끌어올리는 전환점이 될 수 있을지 주목됩니다.